W świecie dynamicznie rozwijających się modeli AI, coraz więcej osób próbuje uruchamiać je lokalnie. Możliwość testowania modeli bez konieczności korzystania z chmury to nie tylko oszczędność, ale też satysfakcja z pełnej kontroli nad środowiskiem. W tym artykule podzielę się swoimi doświadczeniami z uruchamianiem modelu DeepSeek v3 na leciwym laptopie – procesem, który okazał się znacznie bardziej wymagający, niż zakładałem.

Wybór sprzętu i pierwsze wyzwania

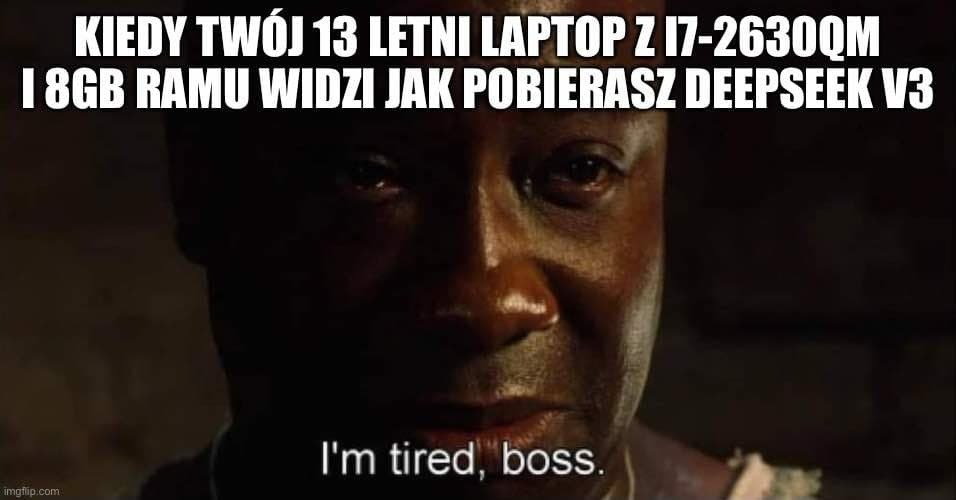

Do eksperymentu wykorzystałem laptopa Asus N55S wyposażonego w procesor Intel i7-2630QM oraz 8 GB pamięci RAM. To sprzęt, który pomimo swojego wieku nadal spełnia moje codzienne potrzeby. Jednak uruchomienie nowoczesnego modelu AI na takim urządzeniu było wyzwaniem samym w sobie. Pierwszy problem pojawił się już na etapie pobierania modelu. DeepSeek v3 wymaga około 400 GB wolnej przestrzeni dyskowej, a moje zasoby były ograniczone. Rozwiązaniem okazało się przekierowanie lokalizacji pobierania poprzez ustawienie zmiennej środowiskowej OLLAMA_MODELS, co umożliwiło zapis danych na zewnętrznym nośniku.